- Autor Lynn Donovan donovan@answers-technology.com.

- Public 2023-12-15 23:51.

- Ostatnio zmodyfikowany 2025-01-22 17:36.

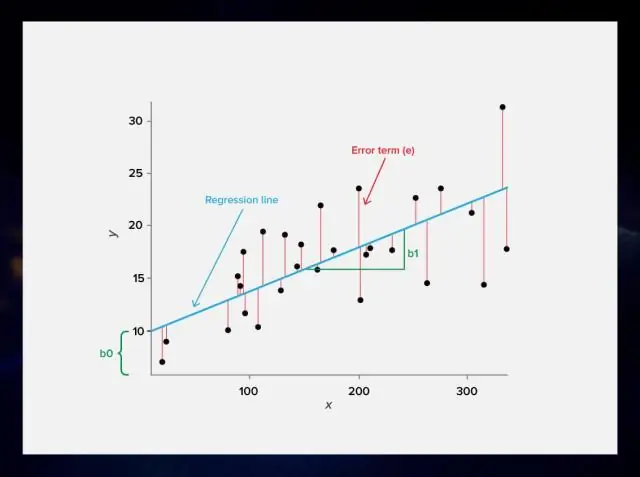

Regularyzacja . To jest forma regresja , który ogranicza/reguluje lub zmniejsza oszacowania współczynnika do zera. Innymi słowy, ta technika zniechęca do uczenia się bardziej złożonego lub elastycznego Model , aby uniknąć ryzyka nadmiernego dopasowania. Prosta relacja do regresja liniowa wygląda tak.

Czym zatem jest lambda w regresji liniowej?

Kiedy mamy wysoki stopień liniowy wielomian używany do dopasowania zbioru punktów w a regresja liniowa konfiguracji, aby zapobiec nadmiernemu dopasowaniu, używamy regularyzacji i uwzględniamy lambda parametr w funkcji kosztu. Ten lambda jest następnie używany do aktualizacji parametrów theta w algorytmie opadania gradientu.

Po drugie, jaki jest cel regularyzacji? Regularyzacja to technika służąca do strojenia funkcjonować dodając dodatkowy termin kary w błędzie funkcjonować . Dodatkowy termin kontroluje nadmiernie zmienne funkcjonować tak, że współczynniki nie przyjmują wartości ekstremalnych.

Dlaczego w ten sposób musimy regulować regresję?

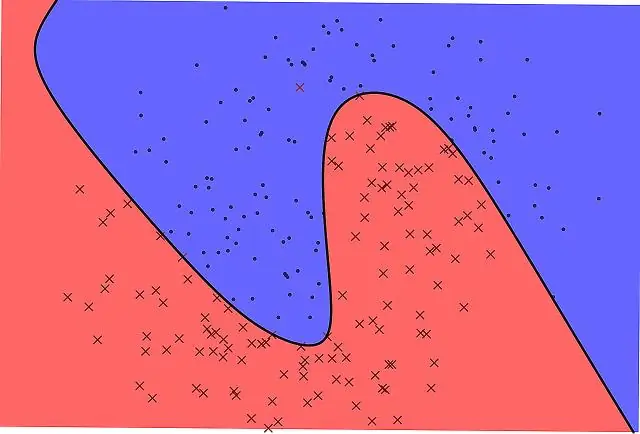

Cel regularyzacja innymi słowy unikanie nadmiernego dopasowania my starają się unikać modeli, które bardzo dobrze pasują do danych uczących (dane użyte do zbudowania modelu), ale słabo pasują do danych testowych (dane użyte do sprawdzenia, jak dobry jest model). Nazywa się to overfittingiem.

Co oznacza regularyzacja?

W matematyce, statystyce i informatyce, szczególnie w uczeniu maszynowym i problemach odwrotnych, regularyzacja jest proces dodawania informacji w celu rozwiązania źle postawionego problemu lub zapobieżenia nadmiernemu dopasowaniu. Regularyzacja dotyczy funkcji celu w źle postawionych problemach optymalizacyjnych.

Zalecana:

Czym jest sztuczna inteligencja, czym różni się od naturalnej inteligencji?

Niektóre z różnic między sztuczną a naturalną inteligencją to: Maszyny ze sztuczną inteligencją są zaprojektowane do wykonywania kilku określonych zadań, zużywając trochę energii, podczas gdy w naturalnej inteligencji człowiek może nauczyć się setek różnych umiejętności w ciągu życia

Co to jest regresja ML?

Regresja to algorytm ML, który można wytrenować w celu przewidywania liczb rzeczywistych danych wyjściowych; jak temperatura, cena akcji itp. Regresja opiera się na hipotezie, która może być liniowa, kwadratowa, wielomianowa, nieliniowa itp. Hipoteza jest funkcją, która opiera się na pewnych ukrytych parametrach i wartościach wejściowych

Jak działa regresja bayesowska?

Z bayesowskiego punktu widzenia formułujemy regresję liniową przy użyciu rozkładów prawdopodobieństwa, a nie szacunków punktowych. Model dla Bayesowskiej regresji liniowej z odpowiedzią próbkowaną z rozkładu normalnego to: Wynik y jest generowany z rozkładu normalnego (gaussowskiego) charakteryzującego się średnią i wariancją

Czy drzewo decyzyjne to regresja?

Drzewo decyzyjne - regresja. Drzewo decyzyjne buduje modele regresji lub klasyfikacji w postaci struktury drzewiastej. Najwyższy węzeł decyzyjny w drzewie, który odpowiada najlepszemu predyktorowi zwanemu węzłem głównym. Drzewa decyzyjne mogą obsługiwać zarówno dane kategoryczne, jak i liczbowe

Czym jest liniowa struktura danych w strukturze danych?

Liniowa struktura danych: Struktura danych, w której elementy danych są ułożone sekwencyjnie lub liniowo, gdzie elementy są dołączone do poprzedniego i następnego sąsiadującego w tak zwanej liniowej strukturze danych. W liniowej strukturze danych zaangażowany jest jeden poziom. Dlatego możemy przemierzyć wszystkie elementy tylko w jednym przebiegu