- Autor Lynn Donovan donovan@answers-technology.com.

- Public 2023-12-15 23:51.

- Ostatnio zmodyfikowany 2025-01-22 17:36.

Przycinanie jest techniką w głęboka nauka który pomaga w rozwoju mniejszych i bardziej wydajnych sieci neuronowe . Jest to technika optymalizacji modelu, która polega na wyeliminowaniu zbędnych wartości w tensorze wagi.

Mając to na uwadze, czym jest przycinanie w sieci neuronowej?

Co jest Przycinanie sieci neuronowych . Mówiąc prosto, przycinanie to sposób na zmniejszenie rozmiaru sieć neuronowa poprzez kompresję. Po sieć jest wstępnie przeszkolony, a następnie dostrojony w celu określenia ważności połączeń.

Poza tym, dlaczego Spareity jest ważne? Rzadkość jest ważna z wielu powodów. To jest ważny mieć jak najmniej neuronów aktywujących się w danym momencie, gdy prezentowany jest bodziec. Oznacza to, że rzadki system jest szybszy, ponieważ można go wykorzystać rzadkość do budowania szybszych wyspecjalizowanych algorytmów.

Biorąc to pod uwagę, czym jest przycinanie w uczeniu maszynowym?

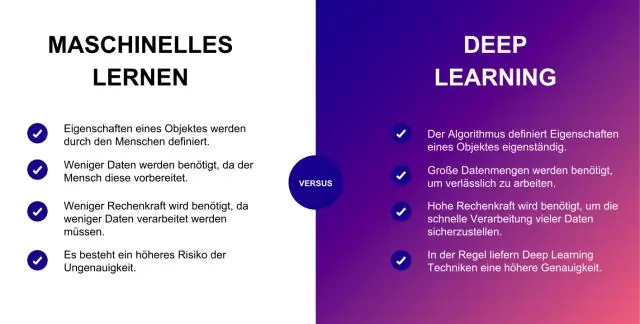

Przycinanie jest techniką w nauczanie maszynowe oraz algorytmy wyszukiwania, które zmniejszają rozmiar drzew decyzyjnych poprzez usuwanie sekcji drzewa, które zapewniają niewielką moc klasyfikacji instancji. Przycinanie zmniejsza złożoność końcowego klasyfikatora, a tym samym poprawia dokładność predykcyjną dzięki ograniczeniu nadmiernego dopasowania.

Dlaczego sieci neuronowe są ważne?

Kluczowe zalety sieci neuronowe : SSN mają zdolność uczenia się i modelowania nieliniowych i złożonych relacji, co jest naprawdę ważny ponieważ w rzeczywistości wiele relacji między wejściami i wyjściami jest nieliniowych i złożonych.

Zalecana:

Czym jest podstawowa prawda w głębokim uczeniu się?

W uczeniu maszynowym termin „prawda podstawowa” odnosi się do dokładności klasyfikacji zestawu szkoleniowego dla technik uczenia nadzorowanego. Termin „ugruntowana prawda” odnosi się do procesu zbierania właściwych obiektywnych (możliwych do udowodnienia) danych do tego testu. Porównaj ze złotym standardem

Czym jest dryf modelu w uczeniu maszynowym?

Z Wikipedii, wolnej encyklopedii. W analityce predykcyjnej i uczeniu maszynowym dryf koncepcji oznacza, że statystyczne właściwości zmiennej docelowej, którą model próbuje przewidzieć, zmieniają się w czasie w nieprzewidziany sposób. Powoduje to problemy, ponieważ prognozy stają się mniej dokładne w miarę upływu czasu

Czym jest framework w uczeniu maszynowym?

Co to jest platforma uczenia maszynowego. Machine Learning Framework to interfejs, biblioteka lub narzędzie, które pozwala programistom łatwiej i szybciej budować modele uczenia maszynowego, bez wchodzenia w sedno podstawowych algorytmów

Jakie algorytmy wykorzystuje się w głębokim uczeniu?

Najpopularniejsze algorytmy uczenia głębokiego to: Splotowe sieci neuronowe (CNN) Rekurencyjne sieci neuronowe (RNN) Sieci z pamięcią długo-krótkoterminową (LSTM) Układane autokodery. Deep Boltzmann Machine (DBM) Deep Belief Networks (DBN)

Czym są ramy w głębokim uczeniu się?

Framework głębokiego uczenia się to interfejs, biblioteka lub narzędzie, które pozwala nam łatwiej i szybciej budować modele głębokiego uczenia się, bez wchodzenia w szczegóły podstawowych algorytmów. Zapewniają jasny i zwięzły sposób definiowania modeli przy użyciu zbioru gotowych i zoptymalizowanych komponentów